まずはこちらのビデオをどうぞ(YouTube のメンテが終わったら、YouTube 版に切り替えます):

これは Wii で発売される新しいマリオゲームで、ご覧の通り、現実世界でふたりのプレーヤーの間に発生したアクションが、仮想世界にも反映されるようになっています。スゴイですねー。

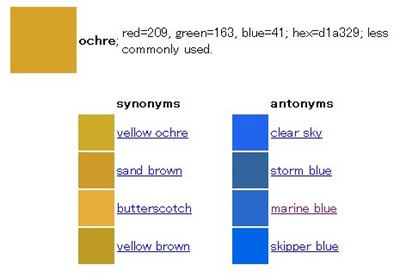

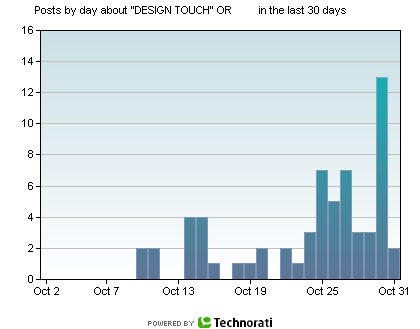

……というのはウソで、実は東京ミッドタウンで行われている「Tokyo Midtown DESIGN TOUCH」というイベントを覗きに来ています。 詳しくは別のブログで書くつもりなのですが、「デザインの街を体感する5日間」ということで、今日から11月4日(日)までの開催となります。

今日のお目当ては、"DESIGN TOUCH Conference"というセミナーシリーズの一環として行われた「インタラクションデザインを先導するメディアアート」という講義。九州大学大学院芸術工学研究院の富松潔教授らが講師をされ、<インタラクションデザイン><メディアアート>という概念の解説と共に、ポストGUIのインタラクションデザインを考えるという内容でした。

で、その中でのヒトコマを撮影したのが冒頭のビデオ。ご覧の通り、コントローラーという入力デバイスを使うのではなく、現実世界でのアクションが仮想世界にも反映されます。と書くと「いまの Wii でも普通に実現してる(コントローラーを振ったり、動かしたりすることで操作できる)じゃん」と言われてしまうので、正確には「現実世界で人間の間に発生したアクションが」という表現になりますが。

ここでのポイントは「学習しなくても使い方が分かる」という点。つまりこれまでなら、「同時にプレイしているプレーヤーのキャラクターを高くジャンプさせるには、十字キーの『上』を押しながらBボタンを叩く」といったような操作方法を学ばなければならなかったのが、「相手のプレーヤーを押す(叩く)」という直感的な操作が可能になっているわけですね。バーチャルのキャラクターは叩けません(タッチスクリーンに表示されているのなら別ですが)ので、実際に叩くのは現実にいるプレーヤーになる、というわけです。

この「学習しなくても使い方が分かる」ということが、富松教授が仰られていた「ポストGUI」のポイントの1つ。そのためにリアルの世界での動き(つまり既に学習済みの動き)がバーチャルの世界に影響を及ぼすという、「ミックスドリアリティ(MR、複合現実感)」が実現されているわけです。「ミックスドリアリティ」のもう1つの例として、ナチュラルマッピングという3次元お絵かきツールが紹介されていたのですが、こちらは現実世界での入力デバイスに装着されたインクボトル(のダミー)の色を変えると、画面上に出力される色も変化するという仕掛けが。これなら、小さな子供でも入力方法を学ばずに遊べますね。

こうした半分リアル、半分バーチャルな世界を構築して、そこでインタラクションを発生させるというアイデアは、既に Wii や iPhone (iPod Touch)、Microsoft Surface などで実現されています。今後は単に触れたり・振ったりという動きを反映するだけでなく、上記のように、リアルな物体の間(ヒト and ヒト、ヒト and モノなど)に発生するインタラクションの取り込みや、リアルとバーチャルがミックスする領域(インクボトルを変えると色が変わる、など)の拡大が行われていくのでしょうね。

ちなみに東京ミッドタウン・デザインハブの中にある、九州大学・芸術工学東京サイトにて、ビデオでご紹介したゲームや他の研究結果の実機を体験できるとのこと。僕が行ったときは残念ながら閉まっていたので、実機は触れられなかったのですが、お時間のある方はぜひどうぞ(研究結果のいくつかは、ソニーで商品化されるそうですよ!)。

最近のコメント